9月23日,中国移动研究院自主完成的论文《面向大模型场景的异构算力分布式并行训练方法》被CCF T1顶级期刊《通信学报》录用,该技术为异构算力合池训练提供了创新突破性解决方案,有效破解多厂商智算资源难以协同的行业痛点。

论文首页

人工智能已成为人类社会数智化转型的关键驱动力,智能算力作为人工智能发展的基石,正不断推动人工智能从单点突破迈向泛在智能新阶段。当前智算产业繁荣发展,多厂商、多代际、多架构智算芯片共存,然而这些芯片在计算架构、软件栈、互联方式等方面存在着较大差异,形成智算芯片间的“资源墙”,难以形成“合力”,限制了多样性智能算力的灵活运用和整体效能释放。另外,在构建超万卡、十万卡规模智算集群过程中,容易出现单厂商绑定问题,这不仅会导致技术栈封闭,还会引发供应链安全风险,因此构建异构混池集群并形成混合训练能力,成为破解这一系列问题的核心路径。为此,中国移动牵头开展跨架构混合并行训练技术研究,旨在充分激活各类型算力资源价值,推动智算融通生态建设。

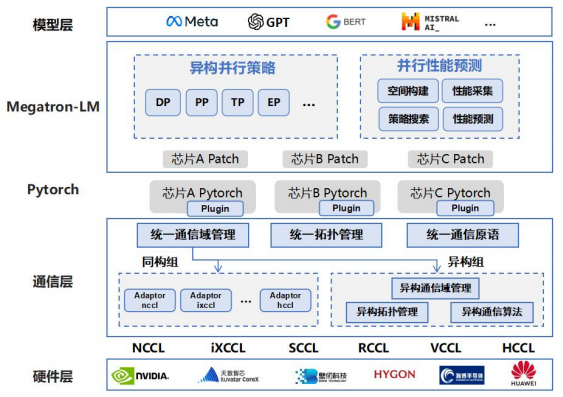

论文创新性设计了一种适用于异构混合智算资源池的大模型分布式并行训练方法,构建起“框架层-通信层”的端到端技术能力:既支持异构非均匀计算任务切分(根据不同芯片的算力差异动态分配计算任务),也能提供最优并行策略的性能预测与推荐,同时,还可实现多厂商互认的统一异构通信能力,其核心创新体现在三方面:

第一,创新新型并行切分模式,实现训练任务负载均衡。

论文创新提出异构混合训练非均匀计算任务切分算法,通过对流水线阶段、数据微批次等进行差异化配置,依据算力大小和计算特性为异构智算集群均衡分配计算任务,实现了训练框架异构非均匀切分能力“从无到有”的开创性突破。

第二,创新最优策略预测推荐机制,降低训练调参成本。

论文提出异构非均匀切分策略寻优技术,通过策略生成算法与性能模拟工具,自动化、智能化生成最优非均匀分布式策略,大幅降低模型异构训练中的超参数配置成本及策略调优成本。

第三,创新统一异构通信机制,实现跨架构数据传输协同。

论文提出异构芯片间统一通信技术,通过统一通信组件、异构通信组件、设备适配器,实现通信拓扑管理、通信域管理、通信原语编排等核心功能,有效解决异构智算芯片间数据无法互通问题。

异构混合分布式训练技术总体架构

在上述技术研究成果基础上,中国移动自主研发的“芯合”异构混训原型系统,已通过信通院AISHPerf体系认证。认证结果表明,该系统支持TP、CP、EP、DP、PP、SP六类异构非均匀并行策略,具备并行策略自动化推荐功能,可支持send/recv、allreduce等九类异构通信原语;同时支持英伟达、昇腾、天数智芯、壁仞科技、海光、瀚博六家厂商的智算芯片,双芯混训加速比超95%。

未来,中国移动研究院将持续深化异构混训技术研究,强化攻关并构建创新技术体系,推动技术成果转化与应用推广,助力全行业“AI+”转型升级和我国算力强国战略落地。

]article_adlist-->

]article_adlist-->

海量资讯、精准解读,尽在新浪财经APP

海量资讯、精准解读,尽在新浪财经APP

冠盈配资提示:文章来自网络,不代表本站观点。